Stell dir vor, du könntest ChatGPT-ähnliche KI auf deinem PC nutzen, ohne dass deine Daten ins Internet wandern. Genau das macht Ollama möglich. Viele kennen KI nur als Online Dienst. Man tippt etwas ein, die Antwort kommt, aber die Daten gehen übers Internet. Das ist oft praktisch, trotzdem will nicht jeder seine Texte, Ideen oder vielleicht auch Kundendaten in eine Cloud schicken.

Stell dir vor, du könntest ChatGPT-ähnliche KI auf deinem PC nutzen, ohne dass deine Daten ins Internet wandern. Genau das macht Ollama möglich. Viele kennen KI nur als Online Dienst. Man tippt etwas ein, die Antwort kommt, aber die Daten gehen übers Internet. Das ist oft praktisch, trotzdem will nicht jeder seine Texte, Ideen oder vielleicht auch Kundendaten in eine Cloud schicken.

Mit Ollama kannst du KI Modelle direkt auf deinem eigenen Windows PC laufen lassen.

Die Anfragen bleiben lokal auf deinem Rechner, und du bist weniger abhängig von Online Konten, Limits oder Ausfällen.

Was ist Ollama?

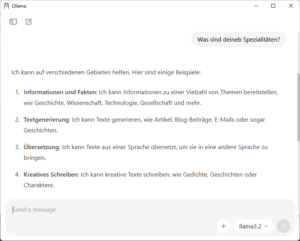

Ollama ist eine Software, die KI Modelle auf deinem PC starten kann. Diese Modelle sind die eigentliche KI. Ollama kümmert sich darum, dass du ein Modell laden, auswählen und benutzen kannst. Früher war das oft eher ein Thema für Leute, die gern mit Konsole arbeiten. Inzwischen ist das für normale Anwender viel einfacher geworden, weil es eine offizielle Windows App mit normaler Programmoberfläche gibt.

Mein persönlicher Eindruck, warum ich so lange gezögert habe

Ich habe mich lange davor gedrückt, Ollama überhaupt auszuprobieren. Nicht weil ich keine Lust auf lokale KI hatte, eher im Gegenteil. Ich bin nur fest davon ausgegangen, dass meine PC Hardware dafür zu klein ist und am Ende alles zäh und unbrauchbar läuft.

Der Punkt ist: Das stimmt so nicht. Ich habe es dann doch gemacht, mit einem ganz normalen Rechner, 16 Gigabyte RAM und ohne starke Grafikkarte. Und ja, man muss realistisch bleiben. Aber für ein erstes Ausprobieren und für viele Alltagsaufgaben konnte ich trotzdem ein brauchbares Ergebnis erreichen. Genau das hat mich überrascht, weil ich vorher davon ausgegangen bin, dass das nur mit dicker GPU Spaß macht.

Der praktische Nutzen für dich als PC Anwender

Der größte Vorteil ist, dass du lokal arbeiten kannst. Das bedeutet:

• Deine Eingaben bleiben auf deinem PC, statt automatisch irgendwo online zu landen.

• Du kannst KI auch dann nutzen, wenn du keine Lust auf Accounts, Abos oder tägliche Limits hast.

• Du kannst es einfach ausprobieren, ohne gleich dein komplettes Arbeiten umzustellen.

Konkrete Beispiele, wofür du das nutzen kannst:

• Vertrauliche Geschäftsbriefe oder E Mails formulieren, ohne dass der Inhalt das Büro verlässt

• Kreative Texte und Ideen entwickeln, ohne dir Gedanken über Nutzungslimits zu machen

• Code Schnipsel erklären lassen oder Fehler finden, ohne deinen Quellcode online zu teilen

• Private Dokumente zusammenfassen oder umformulieren

Wichtig ist nur: Modelle brauchen Speicherplatz und je nach Modell auch ordentlich Rechenleistung. Für den Einstieg ist das aber gut zu steuern, wenn man mit einem kleinen Modell anfängt.

Der neue einfache Einstieg unter Windows , ohne PowerShell

Der entscheidende Punkt für Einsteiger ist die Windows App. Du musst keine PowerShell öffnen und keine Befehle eintippen.

Ollama installieren:

Du lädst den Windows Installer von der offiziellen Ollama Seite und installierst wie ein normales Programm.

Ollama App starten:

Danach startest du die Ollama App. Oft liegt sie im Startmenü, manchmal auch als Symbol im Infobereich bei der Uhr. Modell direkt in der App auswählen und herunterladen: In der Oberfläche kannst du Modelle suchen und herunterladen. Du klickst dein Modell an, der Download läuft, fertig.

Losschreiben:

Wenn das Modell da ist, schreibst du einfach in der App los, wie in einem normalen Chatfenster.

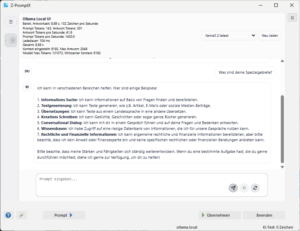

Und wenn du lieber mit deiner eigenen Arbeitsweise arbeitest: Dann nimm Z-Prompt als App für Ollama, dort kannst du Prompts organisieren und direkt an Ollama schicken, ohne dass du jedes Mal die Ollama App offen haben musst.

Welche Modelle zum einfachen Probieren, besonders ohne GPU

Viele PCs haben keine starke Grafikkarte, oder die Grafikkarte wird für so etwas gar nicht genutzt. Dann ist ein kleines Modell der beste Start, damit die ersten Tests nicht frustrieren. Für den Einstieg empfehle ich ein 2B Modell. Es ist nicht so stark wie große Modelle, aber zum Ausprobieren reicht es gut und es läuft auf deutlich mehr Rechnern angenehm.

| Modell | Größe | Alltagstauglichkeit | Kurzbeschreibung |

|---|---|---|---|

| qwen2.5:3b | ca. 1,9 GB | Sehr gut | Sehr guter Alltagshelfer für Schreiben, Umformulieren, Zusammenfassen und Lernen. Mehrsprachig, darunter auch Deutsch. Für Schüler, Studenten und Büroarbeit oft die ausgewogenste Wahl. |

| llama3.2:3b | ca. 2,0 GB | Sehr gut | Solides kleines Standardmodell für tägliche Textarbeit. Gut für Anweisungen, Zusammenfassungen und das Überarbeiten von Prompts. Deutsch wird unterstützt. |

| llama3.2:1b | ca. 1,3 GB | Gut | Die sparsame Variante für schwächere Geräte. Gut für kurze Texte, einfache Fragen, kleine Umschreibungen und leichte Alltagsaufgaben. Weniger stark als 3B, dafür genügsamer im CPU-Betrieb. |

Für normale Anwender ohne starke Hardware ist qwen2.5:3b derzeit die rundeste Wahl. llama3.2:3b ist die solide Alternative, wenn man ein einfaches, bewährtes Standardmodell möchte. llama3.2:1b eignet sich dann, wenn es besonders leicht und flott bleiben soll.

Wenn dir das gefällt und du bessere Antworten willst, kannst du als nächsten Schritt ein größeres Modell testen. Das ist oft spürbar besser, braucht aber auch mehr Rechenleistung und kann ohne starke Grafikkarte deutlich langsamer werden.

Was bedeuten 2B, 3B, 7B, 14B oder 20B bei KI Modellen

Die Abkürzung mit der Zahl und dem B ist eine grobe Größenangabe des Modells. Das B steht für „Billion“, also Milliarden. Gemeint ist fast immer die Anzahl der Parameter im Modell. Parameter kannst du dir wie sehr viele interne Stellschrauben vorstellen, mit denen das Modell Sprache, Wissen und Zusammenhänge abbildet.

• 3B bedeutet ungefähr 3 Milliarden Parameter.

Das ist klein, startet schneller, braucht weniger RAM und läuft oft auch ohne starke Grafikkarte noch ok.

• 7B bedeutet ungefähr 7 Milliarden Parameter.

Das ist oft der Punkt, wo die Antworten spürbar besser werden, aber es braucht deutlich mehr Rechenleistung und meist auch mehr RAM.

• 14B, 20B, 30B und mehr sind entsprechend größer.

Das kann bei schwierigen Aufgaben besser sein, wird aber auf normalen PCs ohne GPU schnell zäh.

Wichtig: Mehr B heißt nicht automatisch „immer besser“. Es heißt vor allem: mehr Anspruch an Hardware, mehr Speicherbedarf, oft längere Antwortzeiten. Fürs einfache Ausprobieren ist klein meistens der bessere Start.

Es gibt noch andere Programme, mit denen du Ollama bedienen kannst

Die offizielle Ollama App ist der einfachste Einstieg. Trotzdem ist sie nicht die einzige Möglichkeit. Weil Ollama lokal eine Schnittstelle bereitstellt, können auch andere Programme damit arbeiten. Das ist praktisch, wenn du eine Oberfläche willst, die mehr Funktionen hat oder einfach anders aussieht.

Typische Beispiele:

• Open WebUI, eine Oberfläche im Browser, mit vielen Komfortfunktionen.

• Desktop Clients wie Chatbox, das ist eher wie ein klassisches Windows Programm für Chats.

• Andere Chat Oberflächen, die Ollama als lokale KI Quelle einbinden können.

Wenn du sowieso schon mit Z-Prompt arbeitest, kannst du Ollama auch darüber bedienen. Es ist im Prinzip deine Arbeitsoberfläche, während Ollama im Hintergrund das Modell liefert. Das ist praktisch, weil du nicht jedes Mal wieder von vorn tippst, sondern mit fertigen Textbausteinen, Rollen und Vorlagen arbeitest. Unterm Strich: Ollama ist die lokale KI im Hintergrund, und Z-Prompt ist die Oberfläche, mit der du sie im Alltag bequemer nutzt.

Fazit

Ollama ist eine einfache Möglichkeit, KI unter Windows 11 lokal auszuprobieren. Der wichtigste Fortschritt für normale Anwender ist die neue Oberfläche: App starten, Modell in der App herunterladen, direkt losschreiben. Keine PowerShell, keine Bastelarbeit.

Für den Anfang nimm ein kleines 3B Modell, damit es auch ohne starke Grafikkarte flüssig bleibt. Und falls du so wie ich lange gezögert hast, weil du deine Hardware für zu schwach hältst: Probier es einfach. Mit 16 Gigabyte RAM kann das bereits überraschend brauchbar laufen, wenn du klein anfängst.