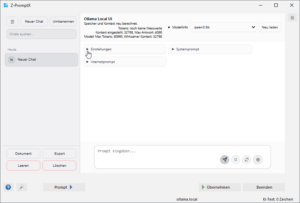

Diese Oberfläche ist dafür gedacht, mit lokalen KI-Modellen zu chatten. Das ausgewählte Modell läuft nicht irgendwo im Internet, sondern auf dem eigenen Rechner oder im eigenen Netzwerk. In der Oberfläche kann man pro Chat verschiedene Einstellungen anpassen. Das ist praktisch, weil nicht jedes Modell gleich arbeitet. Kleine Modelle brauchen oft knappere Vorgaben. Größere Modelle kommen meist besser mit längeren Antworten und mehr Kontext zurecht.

Die wichtigsten Einstellungen befinden sich im Bereich Einstellungen. Zusätzlich gibt es noch und Systemprompt, Internetprompt und Modellinfo Alle Werte gelten pro Chat und werden automatisch gespeichert.

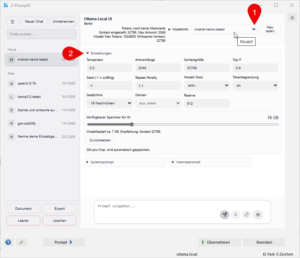

Modell auswählen

Oben rechts kann ein Modell ausgewählt werden. Mit „Neu laden“ wird die Modell-Liste erneut vom lokal installierten Ollama-Server geholt. Nach der Auswahl wird auch die Modellinfo geladen. Die Oberfläche versucht das Modell dabei kurz vorzubereiten, damit die erste echte Anfrage nicht ganz so träge startet.

Praktisch bedeutet das:

Wenn mehrere lokale Modelle installiert sind, kann man für jede Aufgabe das passendere Modell nehmen. Ein kleines Modell für kurze Alltagsfragen, ein größeres Modell für anspruchsvollere Texte.

Wo anfangen?

Für den Einstieg reicht es, den Schieberegler „Verfügbarer Speicher für KI“ auf den Wert zu stellen, der auf dem eigenen PC für die KI zur Verfügung steht – also den freien Arbeitsspeicher oder, falls vorhanden, den VRAM der Grafikkarte. Ollama nutzt VRAM bevorzugt, weil die KI dort deutlich schneller läuft.

Alle anderen Einstellungen können zunächst auf ihren Standardwerten belassen werden. Die Software berechnet daraus automatisch passende Werte für Kontext und Antwortlänge. Erst wenn die Ergebnisse nicht zufriedenstellend sind oder das Modell zu langsam reagiert, lohnt es sich, die einzelnen Einstellungen anzupassen.

Nach einer Änderung am Schieberegler einfach auf Zurücksetzen klicken – die Werte werden dann neu berechnet.

Eigene Werte Einstellen – Fine-Tuning

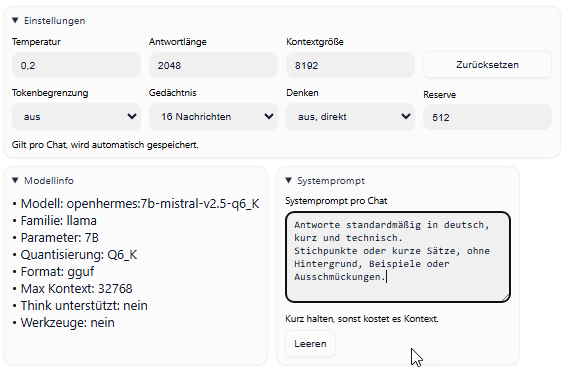

Temperatur

Die Temperatur steuert, wie frei oder wie nüchtern das Modell antwortet. Der Standardwert ist 0,2.

Für die Praxis gilt: Ein niedriger Wert passt gut für sachliche Antworten, Zusammenfassungen, Umformulierungen, technische Fragen und alles, was eher ruhig und vorhersehbar sein soll. Ein höherer Wert passt eher für Ideen, kreative Formulierungen oder wenn das Modell freier schreiben soll.

Als einfache Faustregel: Für den Alltag und verlässliche Antworten ist ein niedriger Wert meist besser. Kleine lokale Modelle profitieren besonders davon, weil sie dann weniger abschweifen.

Antwortlänge

Die Einstellung „Antwortlänge“ steuert, wie lang die Antwort maximal werden darf. Der Standardwert ist 4096 Token.

Ein kleiner Wert sorgt für kurze, schnelle Antworten. Das ist gut für Fragen wie „Erkläre kurz“, „Gib mir drei Punkte“ oder „Fasse das zusammen“. Ein größerer Wert ist sinnvoll, wenn das Modell ausführlicher schreiben soll, etwa für Entwürfe, Anleitungen oder längere Erklärungen.

Wichtig: Zu hohe Werte bringen nicht automatisch bessere Antworten. Gerade bei kleineren Modellen kommt oft mehr Text, aber nicht unbedingt mehr Qualität. Für den Alltag ist der mittlere Standardwert meist sinnvoll.

Kontextgröße

Die Kontextgröße bestimmt, wie viel vom bisherigen Gespräch und von Zusatztexten das Modell gleichzeitig berücksichtigen kann. Der Standardwert wird automatisch berechnet – abhängig vom gewählten Modell und dem eingestellten Arbeitsspeicher. Ausgangspunkt ist 4096, bei ausreichend freiem RAM und einem leistungsfähigen Modell kann der Wert deutlich höher ausfallen.

Mehr Kontext ist nützlich, wenn das Modell sich an mehrere frühere Nachrichten erinnern soll oder wenn längere Texte verarbeitet werden. Weniger Kontext spart Speicher und kann bei kleinen Modellen oder schwächerer Hardware sinnvoll sein.

Einfach gesagt: Wenn das Modell den Faden verliert, kann mehr Kontext helfen. Wenn der Rechner knapp wird oder Antworten zäher werden, kann ein kleinerer Wert besser sein. Über den Button Zurücksetzen wird der Wert neu berechnet.

Gedächtnis

Die Einstellung „Gedächtnis“ legt fest, wie viele der letzten Nachrichten an das Modell mitgeschickt werden. Zur Auswahl stehen 8, 16, 24, 32, 48 und 64 Nachrichten. Standard ist 16.

Ein kleiner Wert ist gut für einfache, kurze Gespräche und spart Platz im Kontext. Ein größerer Wert ist nützlich, wenn das Gespräch länger läuft und frühere Aussagen wichtig bleiben sollen.

Für die Praxis: Wenn das Modell alte Details vergisst, den Wert erhöhen. Wenn die Antworten langsamer werden oder das Modell sich verzettelt, den Wert eher kleiner halten.

Denken

In der Oberfläche gibt es eine Einstellung „Denken“ mit drei Möglichkeiten: „aus, direkt“, „anzeigen“ und „ausblenden“. Diese Einstellung ist vor allem für Modelle wichtig, die einen Denkmodus unterstützen – etwa deepseek-r1, qwen3 und ähnliche.

- aus, direkt ist für den Alltag oft die beste Wahl. Das Modell antwortet direkt, ohne sichtbare Denkspur.

- anzeigen ist nützlich, wenn man sehen möchte wie das Modell intern arbeitet. Das kann beim Testen interessant sein, ist für normale Nutzung aber meist unnötig.

- ausblenden ist sinnvoll, wenn das Modell intern denken darf, man die Denkspur aber nicht im Chat sehen möchte.

Empfehlung: Im normalen Gebrauch zuerst „aus, direkt“ probieren. Das wirkt meist ruhiger und klarer.

Tokenbegrenzung

Die Oberfläche steuert den Verlauf zusätzlich über eine Tokenbegrenzung. Diese Funktion ist standardmäßig eingeschaltet. Wenn sie aktiv ist, kürzt die Oberfläche den Verlauf automatisch so, dass genug Platz für die Antwort bleibt. Dafür gibt es auch die Einstellung Reserve. Die Reserve wird automatisch berechnet – als Richtwert ein Achtel der Kontextgröße, mindestens 256 und höchstens 1024 Token.

Das ist hilfreich bei kleineren lokalen Modellen oder bei längeren Chats. Ohne diese Funktion kann es passieren, dass zu viel alter Verlauf mitgeschickt wird und für die eigentliche Antwort nicht mehr genug Platz bleibt.

Die Reserve ist eine Sicherheitszone – sie lässt dem Modell noch Luft für die Ausgabe. Wenn lange Gespräche unzuverlässig werden, lohnt es sich zu prüfen ob diese Funktion aktiv ist.

Warum nicht nur der Prompt zählt – Einstellungen für den Chat

Systemprompt

Im Bereich „Systemprompt“ kann pro Chat ein kurzer Grundbefehl hinterlegt werden. Praktischer Nutzen:

Damit kann man dem Modell eine feste Arbeitsrichtung geben, zum Beispiel:

„Antworte knapp und sachlich.“

oder

„Erkläre in einfacher Sprache.“

Das ist vor allem nützlich, wenn ein Modell immer in einem bestimmten Stil antworten soll.

Wichtig:

Ein zu langer Systemprompt nimmt Platz weg, der dann für den eigentlichen Chat fehlt.

Internetprompt

Der Internetprompt wird verwendet wenn du vor dem Senden den Internet-Schalter (Globus-Symbol neben dem Eingabefeld) aktivierst. Die Software führt dann automatisch eine Websuche durch und schickt die aktuellen Suchergebnisse zusammen mit deiner Frage an die KI – unabhängig davon ob das gewählte Modell Werkzeuge (Internet Suche) unterstützt oder nicht.

Mit dem Internetprompt kannst du der KI zusätzliche Anweisungen geben wie sie mit diesen Suchergebnissen umgehen soll. Beispiel:

„Nenne immer die Quelle deiner Informationen.“

oder

„Fasse die Suchergebnisse in maximal fünf Sätzen zusammen.“

Halte den Internetprompt kurz – er belegt Kontext. Über Leeren wird er für den aktuellen Chat gelöscht.

Modellinfo

Im Bereich Modellinfo zeigt die Oberfläche verschiedene technische Angaben zum ausgewählten Modell. Dazu gehören zum Beispiel Modellfamilie, Parametergröße, Quantisierung, Format, Kontext aus dem Modell, maximaler Kontext, Unterstützung für Denken und Werkzeugnutzung. Zusätzlich kann auch die letzte Geschwindigkeit angezeigt werden. Für Anwender ist daran vor allem interessant:

- Die Parametergröße gibt grob an, wie groß das Modell ist.

- Der Kontext zeigt, wie viel das Modell grundsätzlich verarbeiten kann.

- Think unterstützt zeigt, ob das Modell mit dem Denkmodus überhaupt etwas anfangen kann.

Das hilft, wenn man mehrere lokale Modelle vergleicht und sich fragt, warum eines anders reagiert als das andere.

Welche Einstellung für welchen Zweck

Für kleine lokale Modelle ist es meist sinnvoll, mit eher vorsichtigen Werten zu arbeiten. Also niedrige Temperatur, normale Antwortlänge, nicht zu viel Gedächtnis und Denken eher aus. Das macht die Antworten oft stabiler.

Für größere Modelle kann man mehr wagen. Also mehr Kontext, bei Bedarf mehr Gedächtnis und längere Antworten. Wenn das Modell Denken sauber unterstützt, kann man das testen, muss es aber nicht dauerhaft eingeschaltet lassen.

Einfache Startempfehlung für den Alltag

Wenn man nicht lange herumprobieren will, ist diese Richtung ein guter Start:

- Temperatur niedrig lassen.

- Antwortlänge mittel lassen.

- Kontextgröße auf dem Standardwert lassen.

- Gedächtnis auf 16 lassen.

- Denken zuerst auf „aus, direkt“ stellen.

- Kurzen Systemprompt verwenden.

- Tokenbegrenzung erst dann einschalten, wenn längere Chats Probleme machen.

Genau dafür ist die Oberfläche ausgelegt, denn diese Werte werden pro Chat gespeichert und können je nach Modell oder Aufgabe unterschiedlich gesetzt werden.

Hinweise zur Speichernutzung

Wie viele Chats kann ich haben?

Die GUI von Z-PromptX speichert maximal 20 Chats. Wenn du einen neuen Chat erstellst und bereits 20 vorhanden sind, wird der älteste Chat automatisch gelöscht.

Wie viele Nachrichten werden pro Chat gespeichert?

Das hängt von deiner Einstellung „Gedächtnis“ ab. Bei 16 Nachrichten werden maximal 48 Einträge pro Chat gespeichert (eine Gesprächsrunde besteht intern aus bis zu 3 Einträgen: deine Frage, Websuche, Antwort). Ältere Nachrichten werden automatisch verworfen.

Was bedeutet das für mich?

Bei einem langen Gespräch „vergisst“ die KI irgendwann die frühen Nachrichten – das ist normal und gewollt, weil der Speicher sonst voll würde. Du kannst das Gedächtnis in den Einstellungen erhöhen, aber dann wächst der Speicherbedarf entsprechend.

Warum startet die KI manchmal langsamer?

Das Modell läuft vollständig auf deinem PC – nicht in der Cloud. Je mehr Gedächtnis und je größer das Modell, desto mehr RAM wird benötigt. Die RAM-Einstellung im Schieberegler hilft dabei, das optimal einzustellen.

Kann ich Chats exportieren?

Ja – der Export-Button speichert den aktuellen Chat als Textdatei, damit du wichtige Gespräche dauerhaft sichern kannst.

Was passiert wenn der Speicher der GUI von Z-PromptX voll ist?

Du siehst eine Meldung in der Statuszeile. In diesem Fall: alte Chats löschen oder den Export-Button nutzen um Gespräche zu sichern, bevor sie automatisch gelöscht werden.