Im ersten Beitrag ging es darum, wie sich Ollama unter Windows installieren lässt und warum für den Einstieg oft schon ein kleineres Modell reicht. Das war die technische Seite. Spannend wird es für mich aber erst danach.

Denn eine lokale KI zu installieren ist das eine. Sie danach im Alltag auch wirklich zu benutzen ist etwas anderes. Genau an der Stelle trennt sich für mich ein nettes Technikthema von etwas, das am Ende tatsächlich im Alltag landet.

Z-PromptX nutzt das, was schon läuft

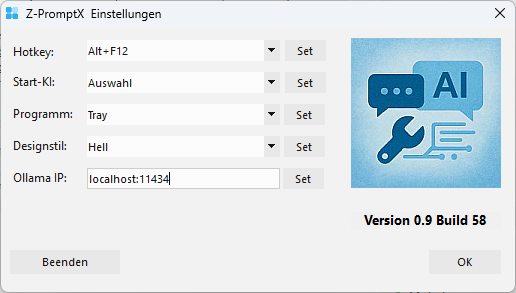

Z-PromptX startet Ollama nicht selbst. Ollama muss bereits installiert sein und laufen. Z-PromptX greift dann auf diese laufende Instanz zu und nutzt sie in der eigenen Oberfläche weiter.

Genau das ist für mich der interessante Punkt. Die KI läuft lokal auf dem eigenen Rechner, aber ich muss dafür nicht dauernd in einer anderen Oberfläche herumklicken. Wenn ich ohnehin schon mit Prompts, Texten und Vorlagen in Z-PromptX arbeite, dann will ich die lokale KI auch genau dort benutzen können.

Gute Ollama Oberflächen gibt es längst

An Oberflächen für Ollama fehlt es nicht. LM Studio, Open WebUI, Jan und AnythingLLM sind bekannt und haben ihre Stärken. Vor allem dann, wenn man mehr verwalten, mehr einstellen oder mehr ausprobieren will.

Ich will das gar nicht kleinreden. Aber viele brauchen im Alltag eben keine halbe Steuerzentrale. Die wollen ein Modell auswählen, etwas eingeben und eine brauchbare Antwort bekommen. Ohne noch ein weiteres Programm zu lernen und ohne wieder irgendwo anders weiterzumachen.

Genau da passt die Anbindung an Ollama in Z-PromptX für mich gut hinein. Nicht als Ersatz für alles andere. Einfach als praktische Lösung.

Lokale KI soll nicht in Arbeit ausarten

Wenn man sich länger mit lokaler KI beschäftigt, landet man schnell bei allem möglichen Drumherum. Docker, Python, Weboberflächen, Zusatzwerkzeuge, Konfigurationskram und noch mehr Zeug, das mit der eigentlichen Nutzung erst einmal wenig zu tun hat.

Wer daran Spaß hat, soll das machen. Mir geht es hier aber um den normalen Einsatz. Wenn Ollama schon läuft, will ich nicht noch den halben Abend an Nebenschauplätzen hängen. Ich will das Modell in Z-PromptX auswählen, meinen Prompt benutzen und sehen, was dabei herauskommt. Mehr brauche ich für viele Dinge gar nicht.

Kleine Modelle werden oft schlechter geredet, als sie sind

Bei lokaler KI wird schnell so getan, als wäre unterhalb großer Modelle kaum etwas Brauchbares möglich. Das sehe ich anders. Kleine Modelle können zu Hause schon ziemlich nützlich sein, wenn man keine Wunder erwartet.

Für Zusammenfassungen, Umformulierungen, kurze E-Mails, Entwürfe, Ideenlisten oder das sprachliche Überarbeiten von Texten reicht ein kleines Modell oft schon erstaunlich weit. Auch wenn ein Dokument geladen ist und ich dazu einzelne Fragen stelle, kommt häufig schon etwas heraus, mit dem ich arbeiten kann.

Klar, es gibt Grenzen. Bei langen Texten, schwierigen Fachfragen oder komplizierten Gedankengängen wird es schnell enger. Aber genau solche Aufgaben habe ich im Alltag nicht ständig auf dem Tisch.

Viel häufiger will ich einen Text glätten, einen Absatz kürzen, eine Seite zusammenfassen oder mir schnell einen ersten Überblick holen. Dafür reichen kleine Modelle oft schon gut aus. Dazu kommt noch etwas sehr Praktisches. Sie starten schneller, reagieren flotter und brauchen weniger Speicher. Das merkt man im Alltag sofort.

Aktuelle Inhalte gehen auch ohne große Suchtechnik

Ein weiterer Punkt ist das Internet. Nicht jeder hat eine Suchschnittstelle. Und nicht jeder will sich überhaupt erst eine bauen. Für viele ist das einfach schon wieder der nächste technische Umweg.

In Z-PromptX können deshalb auch einzelne Webseiten direkt abgerufen werden. Das ist besonders dann praktisch, wenn die Quelle ohnehin feststeht, etwa ein Nachrichtenartikel, eine Dokumentation, ein Blogbeitrag oder eine Produktseite.

Dann muss ich nicht erst eine Suche über viele Treffer davor setzen. Ich lade einfach die Seite, um die es gerade geht. Für viele Aufgaben reicht das schon völlig aus.

Gerade kleinere Modelle kommen damit oft besser zurecht als mit einer ganzen Trefferliste. Sie bekommen direkt den Text, der gebraucht wird, und müssen sich nicht erst durch gemischte Ergebnisse arbeiten. Das macht die Antworten oft klarer und brauchbarer.

SearXNG oder andere Suchdienste gehen später immer noch

Wer mehr will, kann zusätzlich eine Metasuchmaschine wie SearXNG oder einen anderen Suchdienst anbinden. Das ist dann sinnvoll, wenn gezielt im Netz gesucht werden soll und nicht nur eine bekannte Seite geladen werden muss.

Ich sehe das aber eher als Ausbau. Für den normalen Alltag reicht es oft schon, einzelne Seiten direkt zu holen und auswerten zu lassen.

Am Ende ist nur wichtig, ob ich es wirklich benutze

Darauf läuft es für mich hinaus. Ollama stellt die lokale KI bereit. Z-PromptX nutzt diese laufende Instanz in der eigenen Oberfläche weiter. Dazu kommen bei Bedarf eigene Dokumente oder einzelne Seiten aus dem Internet.

Das ist keine große Show. Muss es auch nicht sein. Mir reicht, wenn es praktisch ist und ich es im Alltag tatsächlich benutze.

Wer den ersten Beitrag noch nicht kennt

Die Grundlagen zu Ollama unter Windows habe ich bereits im ersten Beitrag beschrieben: